本文是一篇计算机论文,笔者认为深度学习技术推动了语音识别领域的飞速发展[70]。最近几年以来基于编码器-解码器的端到端语音识别模型凭着简洁的模型结构十分受欢迎[71]。端到端的语音识别模型可直接对语音特征序列到输出的文字序列之间进行建模,不需要先验知识和预对齐过程。

第 1 章 引言

1.1 研究背景及意义

人类一直渴望能够跟计算机无阻碍的交互信息[1-2],尤其是进入信息时代以来人机交互的需求日益增长[3],语音识别技术被称为人机交互的桥梁,能够将人类语音转换到可读的文字序列。语音识别技术每天被全世界数百万人用于日常生活中[4],使给人类带来极大的便利,它的终极梦想是能够让人类更自然,更有效地与计算机进行交流信息。由于语音识别技术所涉及到信号处理,物理学,模式匹配,语言学,计算机科学与人工智能等多个领域的丰富知识,技术难度较大,因此对语音识别研究的入门要求也比较高,语音识别技术诞生以来发展较缓慢。通常在一定规模的数据集上训练出来的语音识别模型,在实际使用环境中容易受口音,方言和噪声的影响,识别性能较低,无法进行大规模实际应用和进一步推广。然而随着深度神经网络模型被用到声学建模以来[5],语音识别模型的鲁棒性和泛化能力有了较大的提升,在各种复杂场景下也能够表现出较好的识别性能,当前最先进的语音识别模型的性能已超过了人类已有的听写水平。

从技术层面来看,语音识别可分两大类,统计方法为代表的传统语音识别模型和纯粹基于深度神经网络的端到端语音识别模型[6]。传统语音识别模型由几个独立的模块组成,其中包括声学模型,发音词典和语言模型。所有这些模块都由独立设计并以不同的目标进行优化。除此之外,传统语音识别模型需要一个复杂的解码器,通过集成声学模型,发音词典和语言模型来实现解码过程。总而言之,传统方法的语音识别模型需要多个领域的丰富知识以及复杂的解码过程,使得整个语音识别过程很繁琐,优化任务艰难。端到端的语音识别模型[7]将常规语音识别模型结构简化为单个深度神经网络结构。此外,端到端的语音识别模型不再需要发音词典,可以直接预测字或单词,因此整个模型结构比传统语音识别模型更简洁,容易优化,且在公开的语音数据集上获得较低的错误率[8],因此无论是学术界还是工业界都开始大量的使用端到端语音识别模型。

1.2 国内外研究现状

语音识别技术拥有 50 多年的发展史,研究员们面对无数的挫折和失败从不放弃,带着激情和拼搏精神才有了当前的水平。在 50 年代初 AT&Bell 实验室首次成功研发出最原始的语音识别系统。到了 60 年代,语音识别主要是以理论研究为主,随后经典的语音识别算法不断被提出。70 年代以来,语音识别领域得到快速的发展,前苏联科学家把模式识别的理论引入到语音识别研究领域并提出了动态时间规整算法,同年代又提出了统计方法用于语音识别的假设。80 年代开始使用概率统计方法研究连续语音识别技术,该方法的核心是通过隐马尔科夫模型进行声学建模,该方法有效推动了连续语音识别技术的发展,不久卡内基-梅隆大学研发出 997 个词汇的连续语音识别系统。进入 90 年代以来基于统计方法的语音识别模型的性能逐步提升,其中混合高斯模型(Gaussian Mixture Model,GMM)- 隐马尔科夫模型(Hidden Markov Model,HMM)[17]被广泛用于声学建模,在此期间先后被提出说话人自适应技术,区分性训练方法和最大似然线性回归等方法用于声学模型参数的更新,这些技术的成功引用将语音识别技术正式走向实际应用阶段。著名的科技公司投入大量资金研发出可实用的语音识别产品,当时 IBM 研发出的 Via voice 系统是当代语音识别技术的明星产物。随后的几十年之间 GMM-HMM 模型逐步成为语音识别领域中的主流框架,常用于连续语音识别的建模。然而该模型因缺乏学习上下文语音特征信息,无法有效学习复杂的非线性特征变换,以及使用EM 算法进行优化模型参数时容易陷入局部极值等缺点在实际语音识别环境中如果遇到一定的噪声干扰,语速,方言等特殊情况,模型性能仍然较低。

随后人工神经网络模型有效解决了上述的一系列问题,它内部由多层互连的神经元组成。最初的神经网络只能做简单的分类任务,由于网络参数都由人工调整导致不能搭建深层网络用于解决复杂的任务。经过多年的研究与探索研究者们提出有效训练深层人工神经网络的反向传播算法,通过该算法可有效更新网络参数。随后通过反向传播算法所训练出来的神经网络模型在序列学习任务中表现出优异的建模能力,从此深度神经网络模型开始被大规模采用到各个机器学习任务。神经网络模型拥有学习复杂非线性关系的能力,可在大量的数据上进行并行计算,能够将定量信息存储在在各个神经元内故有较强的鲁棒性,未在训练过程中所遇到的数据上也能做出合理的推理。

第 2 章 语音识别相关技术

2.1 语音识别原理

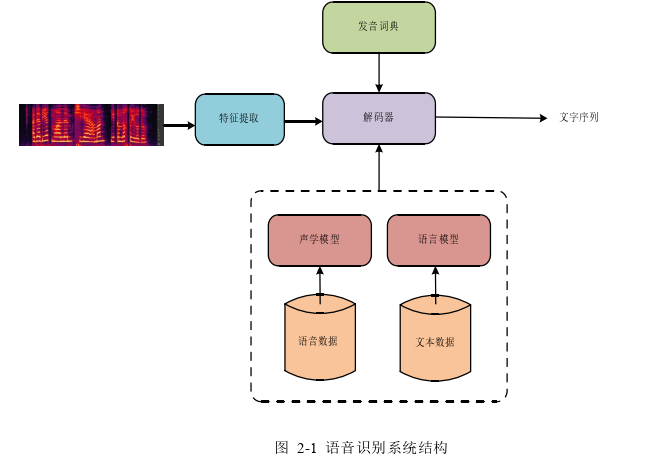

人类语音的产生和感知是一种比较复杂的生理过程,其中由人大脑对发音器官发出运动神经指令,发音器官收到指令以后进行有规律性的振动空气流而产生语音 [28]。人类语音感知器官收到语音信息以后,传输到大脑皮层进行分析并分辨出其中的语音内容。人类从出生开始就不断接受外界的声音,经过较长时间的感知和模仿过程,大脑能够学习到人类语音的发音规律,并理解其中的内容。自动语音识别技术也主要是模仿人类语音感知的工作原理,逐步实现性能较强的语音识别系统。语音所带的信息量比较多,通常语音识别相关的研究工作涉及到信号处理,模式匹配,语言学,计算机科学和人工智能等多个领域的丰富知识,且训练模型需要大量的真实数据和强大的计算能力,因此研发出性能出色的语音识别系统具有一定的难度。传统的语音识别系统结构如图 2-1 所示,主要有 4 个部分组成:特征提取,声学模型,语言模型和解码器。

2.2 预处理和特征提取

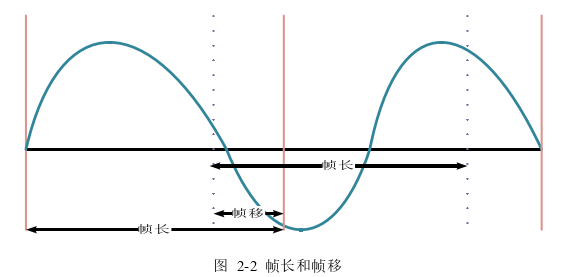

语音包含复杂的信息,能够表达情感,意见和观点。原始的语音信号不能直接作为深度神经网络的输入,需要通过特征工程转换成特征向量表示,然后将特征向量表示送入到模型中进行训练[29]。由于人类发音器官以及语音采集设备对语音信号有一定的影响,通常语音特征提取之前需要进行预处理。预处理过程主要包括预加重,分帧,加窗。通过预加重能有效弥补语音受嘴唇的影响而降低的高频部分能量。语音信号在 10ms 到 30ms 之间具有短时平稳特性,因此通常分帧以后进行语音特征的提取,一般将帧长取为 10ms 或 25ms,为了保证声学特征具有平滑特性,平时通过重叠的方式取帧,帧移设为 10ms。分帧通常是使用指定长度的窗口进行加权方式实现,它能够将语音信号在时域上有限的切割,具体如图 2-2 所示。

第 3 章 基于多任务学习的端到端维吾尔语语音识别 ........................ 24

3.1 引言 ............................. 24

3.2 模型结构及方法介绍 ........................ 25

第 4 章 基于迁移学习的端到端维吾尔语语音识别 ........................... 35

4.1 引言 ............................... 35

4.2 方法及模型结构介绍 .......................... 36

第 5 章 总结 .................. 46

5.1 总结 ......................... 46

5.2 展望 ................ 47

第 4 章 基于迁移学习的端到端维吾尔语语音识别

4.1 引言

语音识别是将人类语音转换成文字序列的技术常常被称为人机交互的重要纽带。语音识别技术给人类生活带来极大的便利。随着深度学习技术被广泛应用到语音识别任务中,语音识别的性能有了很大的提升,其中深度神经网络(Deep Neural Network,DNN)-隐马尔科夫模型(Hidden Markov Model,HMM)是划分时代的语音识别模型结构,DNN-HMM 模型的出现结束了很长时间以来主要是通过统计方法进行声学建模的时代。DNN-HMM 模型具备较强的声学建模能力,抗干扰能力也非常出色,在语音识别任务中表现出出色的识别性能。然而 DNN-HMM 模型需要预对齐过程,还需要通过语言学知识来构造发音词典,以及使用复杂的解码器进行解码,因此 DNN-HMM 模型的整体结构比较复杂,训练和解码过程相当耗时间。近几年以来各种端到端的语音识别模型先后被提出,相比于 DNN-HMM 模型端到端的语音识别模型可直接对语音特征序列到文字序列之间进行建模,不需要复杂的预对齐过程,优化工作相对简单。在汉语和英语的语音识别任务中端到端语音识别模型的性能已经超过了 DNN-HMM 模型的性能,然而训练端到端的语音识别模型需要大量的语音数据,世界上除了极少数的语言拥有丰富的语音数据集,其它大部分语言都缺乏标注的语音数据集,这限制了端到端语音识别技术被广泛应用到低资源语言的语音识别任务当中。

多年以来在机器学习领域中提出无监督学习,元学习,迁移学习[57]和增强学习等方法,用于解决数据资源缺乏导致模型泛化能力不足的问题。其中迁移学习方法是将相关性较强的任务之间实现知识的迁移,进而解决低资源环境下模型泛化能力不足的问题,目前被广泛应用于自然语言处理[58]和图像处理[59]领域。不同语言的语音具有一定的通用特征表示,当前有一些语言中已公开的高质量语音数据规模较大,可通过迁移学习方法将大规模数据集上训练好模型,然后把模型所学习到的知识迁移到低资源的语音识别模型上,进而有效解决低资源环境中语音识别模型性能较低的问题。

第 5 章 总结与展望

5.1 总结

深度学习技术推动了语音识别领域的飞速发展[70]。最近几年以来基于编码器-解码器的端到端语音识别模型凭着简洁的模型结构十分受欢迎[71]。端到端的语音识别模型可直接对语音特征序列到输出的文字序列之间进行建模,不需要先验知识和预对齐过程。当前端到端的语音识别模型中使用多头注意力机制和卷积网络层,使编码器层能够更好的学习长距离特征信息和局部细粒度特征信息,且模型内部不包含递归结构,因此可搭建深层网络模型,使模型能够表现出较好的识别性能[72]。然而端到端的语音识别模型参数量较大,需要大量的数据集上完成模型的训练,相比于数据资源较丰富的英语和汉语,在维吾尔语中可利用的公开语音数据集很少,在端到端的语音识别任务中表现较差。除此之外,维吾尔语属于黏着语,词汇量随着数据规模的增多而剧增,因此基于维吾尔语的语音识别任务中常出现未登录词问题和词汇巨大无法有效训练端到端语音识别模型的问题。本文中为了能够在低资源环境下提升基于维吾尔语的语音识别模型的性能以及解决词汇量巨大而出现的一系列问题,展开了多方面的研究,本文的研究工作如下:

1. 理解语音识别原理以及相关的理论知识,包含当前所使用的预处理技术和特征提取方法。系统性分析多年以来在语音识别领域中所使用的建模方法,其中除了包含典型的 GMM-HMM 声学建模方法以外还包含使用深度神经网络用于声学建模的 DNN-HMM 模型,并了解卷积神经网络和长短期记忆网络模型在语音识别任务中的优缺点。随后梳理当前语音识别任务中所使用的语言模型以及当前的发展趋势。除此之外,分析当前最为流行的端到端语音识别模型并解析连接时序分类和注意力机制方法。

2. 为了能够在训练数据较缺乏的情况下提高语音识别模型的性能,提出基于多任务学习的端到端维吾尔语语音识别模型,其中 Conformer 模型作为共享层,同时以子词和字作为建模单元进行多任务学习。多任务学习模型能够在已有的数据集上通过多个相关任务的学习获得丰富的通用特征信息,这些通用特征信息有利于提高模型的泛化能力。在公开的维吾尔语语音数据集 THUYG-20 上与基线相比把子词错误率和字错误率分别降低 7.3%和3.8%。

参考文献(略)