本文是一篇计算机论文,本文基于深度学习技术对视频的特征提取方法以及特征融合技术进行了研究,取得了一些创新性的进展。

第一章 绪论

1.1 研究背景和意义

1.1.1 课题背景

近几年来,随着信息传播技术的快速发展和自媒体应用软件的更新换代,每天都有海量的视频数据在互联网上被传播。这些海量的视频数据包含了人们的娱乐信息,运动信息,工作信息以及出行信息等。如何高效的处理和归类这些数据,并从中提取出有价值的信息再做出相应的反馈成为计算机视觉领域中的一项重要研究任务。视频中人体动作识别方法可以为该任务提供有效的技术支撑,因此,视频中人体动作识别逐渐成为了机器视觉领域中的热门研究方向之一。

视频中人体动作识别任务是通过计算机分析视频数据中的特征信息,然后根据不同视频包含的特征信息属性来区分出各段视频属于哪一类标签。其中,视频所包含的特征信息主要可以分为两类:其一是确定各帧图像中个体实例(人体和物体)的位置信息和外观信息。该类属于静态特征,容易受光照强弱,背景环境差异,遮挡等因素的影响。其二是确定随着时间的改变个体实例的位置信息和外观信息所发生的变化。这一类属于动态特征,容易受摄像头抖动,动态背景等因素的干扰。因此,在没有人为干预的前提下,这些因素使得该项研究成为难点。

1.2 国内外研究现状

在早期,许多研究者们提出了各种手工特征提取方法用于建模视频中的动态特征,其中包括运动历史图像法,时空兴趣点检测法,运动轨迹跟踪法等。然而,这些方法普遍计算量较大且识别精度较低。近几年来,卷积神经网络在计算机视觉的多个领域取得的显著成果,人们将深度学习方法运用于人体动作识别任务,其识别精度和实时性都显著超越了手工特征提取方法。最初,一些研究者们提出使用图像分类中卷积神经网络来批独处理视频中的帧图像,最后将批处理的计算结果输入到分类层中得到该视频的识别结果。如双流网络[1]使用了两个独立的VGG网络分别来计算堆叠的RGB图像和堆叠的光流图像的特征值,其中堆叠的RGB图像表示视频中某一个时间段上连续的图像帧,堆叠的光流图像表示同一时间段下图像中像素值沿水平方向和垂直方向的动态变化信息。接着采用支持向量机对这两种特征分别进行预测,再融合静态特征和动态特征各自的预测得分,以此来提升算法的识别精度。

双流网络的设计模式对后续所提出的方法影响很大。TSN[2]基于双流网络的基础上提出采用稀疏取帧的方式来采样不同时间段的帧,减少了网络训练过程中相邻帧包含的冗余信息对视频分类造成的影响。TSN虽然利用间隔取帧和网络参数共享的方式使得模型学习到了不同时间段下的图像空间特征的多样性,但由于其对各帧的空间特征只是简单的平均融合,所以网络并没有理解更高级的动态语义信息。Zhou等人提[3]出利用多层感知机来计算有间隔的两张特征图之间的时序依赖关系,以此来模拟人类视觉上的时序推理能力可以有效的帮助神经网络学习动态语义信息。该方法在分析动态特征的能力上大幅度的超越了TSN。

第二章 视频中人体动作识别研究综述

2.1 引言

随着计算机硬件处理能力不断的提高和计算机视觉技术飞速发展,仅对静态图像处理分析已经难以满足人们对计算机视觉智能领域的需求。视频的智能监控和智能分类检索的需求越来越大。识别视频中人物动作已经成为了计算机视觉领域一大热门的方向,其运用领域也极为广泛,无论是在社会公共安全,智能家居或者是人机交互等应用中都具有重要的作用。视频中的人物动作识别主要分为两个步骤,一是让计算机对视频中人物动作的特征信息进行提取,捕捉视频中的重要信息,形成有效的视觉特征,二是对这些视觉特征进行分类,根据不同动作具有的不同特性附上标签。其中,特征提取步骤是动作识别的重点和难点。

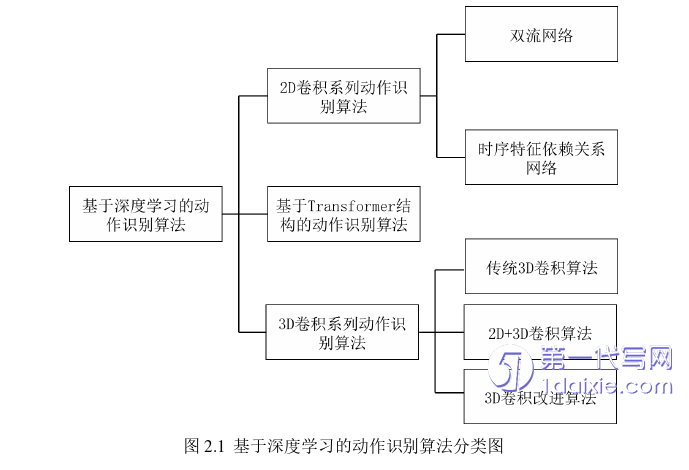

近几年来,动作识别领域取得了很多的进展,早期的动作识别研究综述没有针对分析近几年神经网络理解复杂动作的角度来论述。文献[14]从全局和局部两个角度的特征表示的来论述特征提取的方法。Chen[15]等人于单独的深度传感器和单独的惯性传感器对人类动作识别应用进行了论述。文献[16-18]对2016年以前被提出有关动作识别的数据集进行了介绍和比较。文献[19]讨论了基于手工提取动作特征方法的优点和不足。文献[20]从模型输入信号的类型和数量为角度,分析了早期的深度学习网络模型与传统特征提取算法的优劣。与以上文献综述不同,本章根据深度学习网络结构的差异将近几年流行的动作识别算法归类为2D卷积系列,3D卷积系列和基于Transformer结构系列(如图2.1所示)。旨在对当前主流动作识别算法进行归纳和梳理,方便为后续研究提供启发。

2.2 基于2D卷积神经网络的动作识别算法

2.2.1 双流网络

自卷积神经网络在图像分类领域取得超高的准确率后,一些研究者们开始尝试将卷积神经网络迁移到动作识别任务中用于视频理解。然而,虽然动作识别和图像分类都属于分类任务,但由于数据对象的模态不同,因此在处理视频特征时也遇到了很多的挑战。在动作识别任务中,除了视频中包含的静态信息(如人体位置,人体形态大小,场景)等外,帧与帧之间的动态信息也是归类动作标签的重要依据。然而,从图像分类任务中迁移的神经网络结构不具备动态信息理解的能力,为了解决这个问题,研究者们提出了使用光流(Optical Flow)信号来表示动态特征。

光流信号表示的是图像上对应位置的亮度变化信息。在视频中,人体或物体在运动的过程中,对应像素的亮度特征也会相应发生变化。2014年,simonyan等人[1] 最早提出一种双流网络方法。该网络基于二流假说的启发,采用两个独立的卷积神经网络分别计算RGB图像和堆叠的光流图的动作预测分数,然后平均计算各自的得分作为模型的识别准确率,如图2.2所示。其中,RGB图像表示了静态的特征信号,而堆叠的光流图表示了连续帧之间像素点的变化信息。通过一静一动的两种视觉信息互补,双流网络可以有效的集成空间特征和时序特征的分类结果来提升模型的识别准确率,避免单视觉造成的识别精度的误差。

第三章 时空卷积注意力网络用于动作识别 ................................ 21

3.1 引言 ............................................ 21

3.2 相关工作 ................................. 23

3.2.1 基于2维卷积神经网络的方法 ............................. 23

3.2.2 自注意力方法 ..................................... 23

第四章 时空交互模块用于动作识别 ................................ 33

4.1 引言 .......................................... 33

4.2 相关工作 ..................................... 34

4.2.1 空间维度的2D卷积用于动作识别 ......................... 34

4.2.2 时序维度的1D卷积用于动作识别 ............................. 34

第五章 时空特征聚合网络用于动作识别 ............................. 45

5.1 引言 ....................................... 45

5.2 提出的方法 ....................................... 46

5.2.1 DFE模块 ......................... 46

5.2.2 多级特征聚合模块 ......................... 48

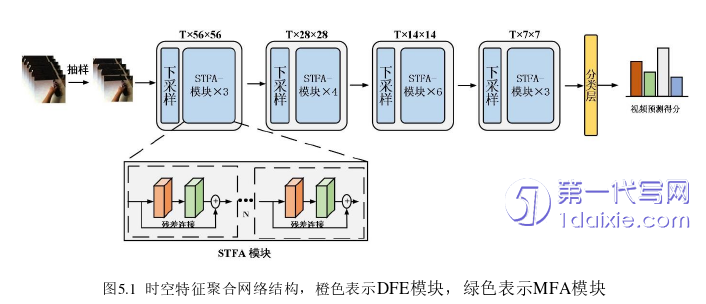

第五章 时空特征聚合网络用于动作识别

5.1 引言

特征聚合是目前基于深度学习的动作识别算法中常用的一种设计理念。它是指通过一系列方法对神经网络提取的时序特征和空间特征进行充分整合,以形成有效的视频级特征表示。在时空特征聚合理念被提出之前,大多数研究者们依赖于两种方式来获得模型识别精度上的提升。一是使用参数量较多的3D卷积网络,通过3D卷积可以同步计算时空特征的优势,来获得丰富的视频级的特征表示。二是采用集成多个帧级特征在不同分类器上的预测分数来提升模型的识别效果。然而,这两种方法均存在着各自的缺陷,例如:训练多个分类器非常耗时,模型参数量大,视频级特征的质量较差等等。

近几年里,时空特征聚合理念被广泛提出。2019年,Luo等人[48]以双流网络为主干,提出了空间流和时间流特征级别上的乘法融合,并探究了网络中最佳融合的位置。文献基于残差网络将卷积层的通道分解成空间组和时间组,用空间组和时间组分别提取空间特征和时序特征,然后再使用拼接聚合的方式对两种特征进行聚合。2020年,Song等人[98]提出一种视频级二维特征的表示方法,将视频的每一帧都矢量化的表示为时空特征图里的一行特征向量,接着采用浅层的卷积神经网络来处理时空特征图来生成更丰富的视频级特征表示。2021年,Wang等人[64]在2D卷积神经网络上插入了3种自注意机制模块用于获取通道激励信息,时序关联信息和空间关联信息,然后采用对应点相加的方式融合三种不同的信息以生成鲁棒的视频级特征。

第六章 总结与展望

6.1 本文工作总结

视频中人体动作识别是计算机视觉领域的一项热门研究方向,其在视频监控,人机交互、运动检测等多项领域都有着巨大的应用价值。本文基于深度学习技术对视频的特征提取方法以及特征融合技术进行了研究,取得了一些创新性的进展。具体内容总结如下:

(1)为了方便初学者从宏观的角度全面的了解近几年内视频中人体动作识别研究工作的进展。本文对目前主流的几种动作识别算法进行了详细的介绍和归纳。不同于传统的分类方法,本文从特征融合的角度将目前流行的算法分为三个系列进行综述:2D卷积系列动作识别算法、3D卷积系列动作识别算法和基于Transformer结构的动作识别算法。本文详细的介绍了这几种系列算法的发展历程,并基于识别效果和算法效率分析了这些方法的优势和不足。

(2)针对卷积神经网络和自注意力机制各自存在的不足,本文提出了一种将卷积神经网络与自注意力机制相结合的神经网络结构。利用自注意力机制在联系上下文把握全局特征信息的优势来提取视频在空间维度和时间维度的全局特征,再用卷积算子替换自注意机制中用于特征编码的学习矩阵,补充自注意力机制对局域特征学习能力的不足。接着引用双流网络的思想,设计了分别用于空间自注意力机制和时间自注意力机制的双流结构。实验研究证明,在UCF101和HMDB51数据集上,本文提出的方法有较好的识别性能。

(3)由于3D卷积的参数量巨大,而传统的2D卷积由不具备联系前后帧学习动态特征信息的能力。受自注意力机制的启发,本文提出了一种时空特征交互的模块用于学习时序特征并实现时空特征交互。该模块采用了两个通道不对称的1D卷积沿时间维度学习相同位置上不同帧之间的特征关系,在用激活函数对特征关系信息激活,用乘法融合的方式将时序特征信息融合到空间特征中。相比较于前一章的时空卷积自注意力网络,该方法能够节约更多的网络参数,且更有利于学习长尺度的时序依赖关系特征。实验结果表明,时空交互模块的参数量的参数量很小,但在提取长尺度的时序依赖关系特征的能力不亚于3D卷积和伪3D卷积。

参考文献(略)